– Arief Prihantoro –

Dunia telah menyaksikan munculnya model bahasa besar (LLM) seperti Gemini, GPT, DeepSeek atau Claude, yang mampu memproses dan menghasilkan teks dengan kompleksitas yang luar biasa. Model-model ini sering dianggap sangat pintar karena memiliki pengetahuan ensiklopedis dan kecepatan pemrosesan yang melebihi kemampuan manusia. Namun, di balik kecerdasan instan ini, tersimpan sebuah paradoks mendasar: entitas digital ini secara fundamental adalah makhluk yang pelupa. Model AI saat ini beroperasi dalam kondisi “sekarang yang abadi,” di mana setiap respons yang dihasilkan didasarkan pada pola yang dipelajari, bukan dari ingatan yang persisten.

Keterbatasan model utama-model generatif konvensional terletak pada apa yang disebut memori kerja (memori kerja) atau jendela konteks ( jendela konteks) . Memori kerja ini didefinisikan sebagai sejumlah informasi kecil yang dapat disimpan dalam pikiran dan digunakan untuk menjalankan tugas kognitif, seperti perencanaan, penalaran, atau pemecahan masalah. Pada AI, ini setara dengan batas input token yang dapat diolah dalam satu sesi dialog. Informasi di luar jendela konteks tersebut akan hilang. Begitu percakapan berakhir atau konteks melebihi batas, ingatan tersebut hilang, dan AI harus memulai lagi dari nol pada sesi berikutnya. Inilah yang menghalangi kemampuan AI untuk mencapai pembelajaran seumur hidup (lifelong learning ) , sebuah konsep yang penting bagi evolusi kecerdasan berkelanjutan.

Bayangkan AI (seperti ChatGPT atau Gemini) adalah seorang jenius yang sangat cepat membaca, namun sayangnya ia menderita amnesia setiap kali menutup buku. Dalam dunia AI, ini disebut masalah jendela konteks . Jika kita memberikan 10 buku, saat sampai di buku ke-11, ia mulai lupa apa warna baju tokoh utama di buku pertama.

Google Research memperkenalkan arsitektur Titans dengan mekanisme Meta-Learning for Memory untuk mengatasi ini, dengan kerangka kerja Memory and Retention Architecture Search (MIRAS). Tujuan utama dari inovasi ini adalah mencapai test-time memorization, kemampuan AI untuk mempertahankan memori jangka panjang dengan menggabungkan informasi baru ke dalam memori intinya secara instan, bahkan saat model sedang berjalan aktif, tanpa memerlukan pelatihan ulang offline yang masif dan mahal.

Dalam fisika neuron, ingatan jangka pendek kita mirip dengan aliran listrik yang lewat di kabel: cepat, tapi begitu listrik mati, sinyalnya hilang. Cara kerja Titans bisa dianalogikan secara fisis dengan mengubah “arus listrik” yang lewat menjadi “perubahan fisik” pada material kabelnya sendiri, melalui mekanisme Retention gate dan Memory Algorithm.

Retention gate sebagai pengatur memori. Melalui mekanisme Retention gate, MIRAS menafsirkan ulang “mekanisme pelupaan” sebagai bentuk pengaturan spesifik yang menyeimbangkan pembelajaran baru dengan retensi pengetahuan masa lalu. Sedangkan Memory Algorithm adalah algoritma pengoptimalan yang digunakan untuk memperbarui memori. Secara teknis, ini mirip dengan plastisitas sinaptik dalam otak manusia.

Bayangkan otak Anda bukan cuma kabel, tapi seperti lilin. Saat ada informasi masuk (panas), lilin itu meleleh dan membentuk pola. Ketika dingin, pola itu tetap ada tanpa perlu dialiri listrik terus-menerus.

Dalam Titans, AI tidak lagi sekadar “menyimpan data” di rak buku, tapi ia “mengubah dirinya” (memperbarui weights atau bobot secara dinamis) untuk mengingat konteks jangka panjang. Ia punya “ruang ingatan saraf” yang elastis. Jadi, saat ia membaca buku ke-11, ia tak perlu mengecek catatan; ingatan itu sudah menyatu dalam struktur fisiknya.

Solusi Sementara dan Kebutuhan Evolusi Diri

Untuk mengatasi pengetahuan yang cepat kadaluarsa (karena model dilatih berbulan-bulan atau bertahun-tahun lalu) dan kebutuhan untuk menggunakan data privat spesifik, muncullah metode Retrieval Augmented Generation (RAG). RAG menjadi sangat populer karena ia memperkuat LLM dengan kemampuan untuk mencari dan mengambil informasi baru kapan saja dari sumber eksternal.

Meskipun RAG sangat kuat dan menjadi standar dalam sistem AI korporat, ia hanyalah sebuah sistem pencarian referensi eksternal. RAG tidak mengubah struktur kognitif model itu sendiri. Model hanya membaca “buku referensi” yang diperbarui, tetapi ia tidak mengintegrasikan pengetahuan baru ke dalam “otaknya”. Ini berarti RAG tidak mengubah “dirinya” secara struktural.

Agar AI dapat mencapai kemampuan adaptasi dan evolusi diri (self-evolution) yang sebenarnya, model harus dapat mempersonalisasi dan terus belajar dari pengalaman yang terakumulasi.

Tujuan Titans dan MIRAS: Mengaktifkan Memori Jangka Panjang Instan

Pengembangan Titans dan MIRAS menandai lompatan penting dari kinerja yang bersifat transien (sementara) menjadi identitas yang persisten. Jika AI berhasil mereplikasi mekanisme memori jangka panjang biologis, ia akan berubah dari mesin yang hanya cerdas dalam konteks pendek menjadi agen yang mampu beradaptasi dan belajar secara berkelanjutan.

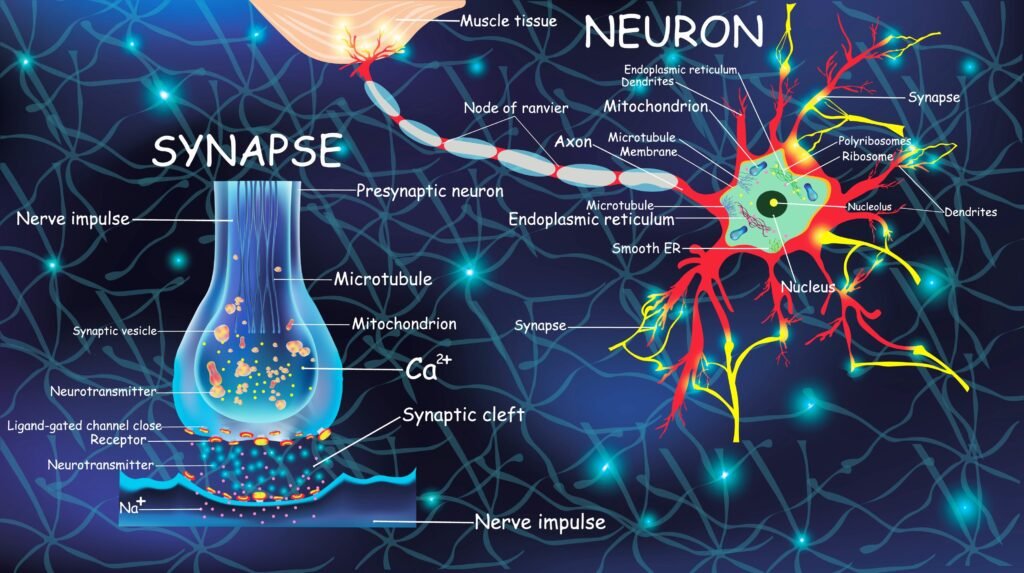

Untuk memahami bagaimana Titans dan MIRAS mencoba memecahkan masalah memori AI, penting untuk mengacu pada cetak biru terbaik yang tersedia: otak manusia. Memori jangka panjang biologis dibangun di atas dua prinsip fundamental: plastisitas struktural dan mekanisme penguatan sinaptik yang selektif. Titan dan Miras menjadi Blueprint untuk memori yang tangguh meniru Biologi Ingatan.

Neuroplastisitas: Otak Sebagai Karya Seni Biologi yang Elastis

Tidak seperti chip komputer yang strukturnya statis, otak manusia adalah karya seni biologis yang terus berevolusi. Kemampuan adaptasi luar biasa ini dalam neurosains dikenal sebagai neuroplastisitas, kemampuan otak untuk mengubah struktur dan fungsinya sebagai respons terhadap pengalaman dan lingkungan.

Agar AI dapat “beradaptasi” dan “tumbuh” seperti manusia, ia harus mengadopsi prinsip plastisitas ini, sehingga memungkinkan parameter intinya berubah secara dinamis, bukan sekadar membaca data tambahan. Perubahan ini terjadi pada tingkat sel saraf, khususnya pada persimpangan antara neuron yang disebut sinapsis. Memori terbentuk bukan dengan menulis data pada hard drive, melainkan dengan memperkuat atau memperlemah koneksi antar sinapsis dan dendrit.

Long-Term Potentiation (LTP): Fisika Penguatan Sinapsis

Fondasi fisik dari memori jangka panjang (LTM) biologis adalah proses yang disebut Long-Term Potentiation (LTP). LTP adalah mekanisme biologis yang memastikan bahwa sinapsis menjadi lebih kuat dan lebih sensitif terhadap sinyal di masa depan setelah menerima stimulasi yang frekuensinya cukup tinggi dan signifikan.

Proses ini dapat dianalogikan dengan sebuah sirkuit listrik biologis yang diatur oleh dua jenis pintu gerbang ion (reseptor) utama sebagai berikut:

a. Mekanisme Pemicu dan Gerbang Kejutan

- Aktivasi Dasar (Reseptor AMPA): Komunikasi di sinapsis biologis dimulai ketika neuron presinaptik melepaskan neurotransmitter Glutamat. Molekul ini akan mengikat reseptor AMPA pada neuron pasca-sinaptik. Reseptor AMPA, ketika aktif, memungkinkan masuknya ion Natrium (Na+) ke dalam sel, menyebabkan neuron pasca-sinaptik terdepolarisasi, yaitu terjadi perubahan tegangan listriknya. Depolarisasi ini adalah transmisi sinyal standar.

- Gerbang Kejutan (Reseptor NMDA): Reseptor kunci dalam pembentukan memori adalah reseptor NMDA. Reseptor NMDA awalnya terblokir oleh ion Magnesium (Mg+). Bahkan jika Glutamat dilepaskan, ion Kalsium (Ca2+) tidak dapat masuk. Reseptor NMDA bertindak sebagai “gerbang kejutan” yang bergantung pada tegangan listrik.

- Kalsium, Mediator LTP: Hanya jika terjadi depolarisasi yang cukup kuat (stimulasi frekuensi tinggi, yang menandakan pentingnya informasi tersebut), sumbatan Mg+ pada reseptor NMDA akan terangkat. Begitu sumbatan ini hilang, ion Kalsium (Ca2+) akan mengalir masuk ke dalam sel. Ion Kalsium ini adalah mediator utama dari LTP, berfungsi sebagai sinyal internal yang menyatakan bahwa informasi atau pola ini layak untuk disimpan secara permanen (Kejutan Tinggi).

Mekanisme Biologis “metrik kejutan” tersebut dalam konteks Titans analog dengan model yang mendeteksi perbedaan besar antara apa yang diingatnya saat ini dan apa yang disampaikan masukan baru. Mengutip artikel https://research.google/blog/titans-miras-helping-ai-have-long-term-memory/ tentang 2 jenis kejutan:

- Kejutan rendah : Jika kata baru adalah “kucing” dan status memori model sudah mengharapkan kata hewan, gradiennya (kejutan) rendah. Model dapat dengan aman melewati proses menghafal kata “kucing” dalam status jangka panjangnya yang permanen.

- Kejutan tinggi : Jika status memori model meringkas laporan keuangan yang serius, dan masukan baru berupa gambaran kulit pisang (peristiwa tak terduga), gradien (kejutan) akan sangat tinggi. Ini menandakan bahwa masukan baru tersebut penting atau anomali, dan harus diprioritaskan untuk penyimpanan permanen dalam modul memori jangka panjang.

Model ini menggunakan sinyal kesalahan internal (gradien) sebagai padanan matematis untuk mengatakan, “Ini tak terduga dan ini sangat penting!” Hal ini memungkinkan arsitektur Titans untuk secara selektif memperbarui memori jangka panjangnya hanya dengan informasi yang paling baru dan inovatif, sehingga proses keseluruhan tetap cepat dan efisien.

b. Konsolidasi: Perubahan Struktural Jangka Panjang

Masuknya ion Kalsium memicu serangkaian mekanisme seluler yang memperkuat sinapsis, mengonsolidasikan memori dalam dua fase:

- Fase Awal (Memori Jangka Pendek): Kalsium menginisiasi jalur sinyal yang mengaktifkan berbagai protein kinase. Kinase ini melakukan dua hal: Pertama, mereka memfosforilasi reseptor AMPA yang sudah ada, meningkatkan konduktansinya terhadap ion Natrium. Kedua, mereka membantu memindahkan lebih banyak reseptor AMPA dari penyimpanan internal sel ke membran pasca-sinaptik. Peningkatan jumlah dan sensitivitas reseptor ini membuat sel lebih responsif terhadap Glutamat di masa depan. Fase ini mendasari memori jangka pendek yang bertahan beberapa jam.

- Fase Akhir (Memori Jangka Panjang): Untuk menjamin memori bertahan lama, terjadi proses yang lebih mendalam: sintesis protein baru dan aktivasi ekspresi gen. Perubahan ini menghasilkan reseptor AMPA baru dan, yang paling penting, modifikasi struktural pada sel, seperti pertumbuhan koneksi sinaptik baru (dendritic spines). Perubahan struktural inilah yang menjamin responsivitas sinapsis bertahan long-lasting.

Pentingnya Pelupaan Selektif

Ketika mendesain AI untuk memiliki LTM, ada pemahaman mendalam yang tidak boleh diabaikan: memori biologis bukanlah perekam yang sempurna. Jika kita mengingat setiap detail tunggal kehidupan, sistem kognitif akan menjadi kewalahan dan tidak produktif.

Otak manusia secara alami berevolusi untuk melakukan selective forgetting (pelupaan selektif), yaitu memfilter informasi yang dianggap bernilai rendah atau jarang digunakan. Tanpa mekanisme regulasi ini, proses pembelajaran baru akan merusak ingatan lama (fenomena yang disebut catastrophic forgetting), yang pada akhirnya akan menghambat efisiensi. Oleh karena itu, arsitektur AI yang ambisius, seperti Titans/MIRAS, tidak hanya harus meniru penguatan (LTP) tetapi juga mekanisme regulasi yang setara dengan pelupaan selektif untuk mencegah ketidakstabilan dan memastikan pembelajaran yang efisien.

Titans dan MIRAS Menduplikasi Fisika Memori di Dunia Digital

Kerangka MIRAS adalah upaya untuk mereplikasi proses LTP yang selektif dan adaptif, memindahkannya dari biologi neuron ke arsitektur jaringan saraf. Ini bukan sekadar peningkatan memori, melainkan upaya untuk mengaktifkan perubahan struktural pada AI selama interaksi.

Test-Time Memorization: Membentuk Sinapsis Digital

Tujuan kunci MIRAS adalah test-time memorization, kemampuan model untuk memperbarui parameter inti atau bobot internalnya saat sedang digunakan (saat inference), bukan hanya saat pelatihan offline. Ini memungkinkan model untuk “mengintegrasikan detail baru dan spesifik ke dalam pengetahuan intinya secara instan”, yang secara fungsional setara dengan membentuk sinapsis baru atau memperkuat yang sudah ada di otak biologis.

Titans mencapai ini dengan menggunakan arsitektur memori yang kompleks. Berbeda dengan memori AI sederhana yang menggunakan vektor atau matriks, Titans memanfaatkan deep multi-layer perceptron (MLP) sebagai struktur penyimpanan informasi. Penggunaan MLP yang mendalam ini memberikan kapasitas yang jauh lebih besar dan lebih kompleks untuk menyimpan relasi dan konteks jangka panjang.

Analisis Kritis Pilar Utama MIRAS

- Attentional Bias (Metric Kejutan): Pilar ini adalah inti dari mekanisme selektif yang baru. Mirip dengan Reseptor NMDA pada otak biologis, yang hanya terbuka ketika ambang tegangan yang tinggi tercapai dan memungkinkan masuknya Ca2+. Attentional Bias pada MIRAS menggunakan metrik “kejutan” (surprise metrics) untuk menentukan apa yang penting. Model hanya memproses dan menyimpan informasi yang dianggap mengejutkan atau tidak terduga, yang secara signifikan menyimpang dari prediksi model saat ini. Informasi yang sudah sesuai dengan prediksi (tidak mengejutkan) diabaikan. Selektivitas ini menghemat sumber daya komputasi dan menghindari beban data yang tidak perlu.

- Memory Algorithm (Optimasi Online): Ini adalah jantung operasional Titans. Model LLM konvensional menggunakan offline optimization (pre-training) yang membuat pengetahuannya statis. Sebaliknya, MIRAS mengaktifkan online optimization yang dilakukan melalui optimasi berbasis gradien (gradient-based optimizer). Proses ini memungkinkan model untuk secara aktif belajar dan memperbarui parameter intinya saat data masuk. Ini meniru penguatan sinaptik yang terjadi secara biologi.

- Retention Gate (Regularisasi Memori): Peran regulator ini sangat penting. Fungsi Retention Gate adalah sebagai regulator memori yang menyeimbangkan pembelajaran baru dengan retensi pengetahuan yang sudah ada, yang secara eksplisit mencegah pembelajaran baru merusak ingatan lama. MIRAS menafsirkan mekanisme pelupaan sebagai bentuk regularisasi. Dengan meniru selective forgetting, gerbang ini menjaga stabilitas sistem.

Keberhasilan MIRAS terletak pada pengaktifan online optimization. Rantai kausalitasnya adalah:

Interaksi Pengguna => Deteksi Kejutan (Attentional Bias) => Filtrasi (Retention Gate) => Pembaruan Bobot Inti (Memory Algorithm).

Ini memberikan AI jalur kausalitas yang memungkinkan model untuk belajar dari pengalaman unik dan bukan hanya dari data pelatihan yang sudah dikurasi dan statis. Inilah fondasi yang memungkinkan AI self-evolution, di mana model dapat mempersonalisasi dan terus-menerus meningkatkan kemampuannya berdasarkan akumulasi pengalaman yang unik.

Sintesis Kognitif: Apakah Memori Long Term Membuat AI Menjadi Pandai?

Dengan memori jangka panjang yang adaptif (LTM), AI melangkah maju dalam hierarki kognitif. Untuk memahami status baru AI ini, kita harus menerapkan kerangka kerja yang membedakan antara kecerdasan, kepintaran, dan kepandaian dalam konteks akal imitasi.

Penting untuk membedakan antara tiga komponen kunci:

- Cerdas (Potensi Bawaan): Ini merujuk pada potensi bawaan AI, yang ditentukan oleh arsitektur fisik dan jumlah parameter. Arsitektur yang kompleks (seperti arsitektur Transformer yang masif) memberikan AI kapasitas untuk merajut relasi antar data. Mirip dengan siswa yang memiliki otak yang potensial. Titans, dengan arsitektur MLP-nya yang kompleks, memberikan potensi cerdas yang lebih besar.

- Pintar (Pengetahuan Terserap): AI menjadi pintar setelah proses belajar. Model telah menyerap banyak pengetahuan dari data pelatihan masif (data training) sehingga mampu menjawab soal-soal serupa. Ini terjadi melalui algoritma optimasi (seperti gradient descent) yang memperbarui bobot model berdasarkan kesalahan yang dihitung.

- Pandai (Kemahiran karena Latihan Berulang): AI menjadi pandai jika ia memiliki kemahiran dalam mengerjakan tugas tertentu berkat latihan berulang-ulang. Kepandaian melibatkan pemahaman pola yang mendalam, bukan sekadar kemampuan menjawab soal di kelas.

Peran LTM dalam Menggeser Posisi AI dari Pintar ke Pandai

AI tradisional sudah sangat pintar karena telah menelan triliunan token data. Namun, model ini sering kali gagal menjadi pandai karena kurangnya kemampuan untuk menyesuaikan diri dan menguasai konteks yang unik dan spesifik, yaitu kurangnya latihan berulang dalam lingkungan nyata. LTM Titans/MIRAS secara fundamental menutup celah ini.

1. Latihan Berulang Digital

MIRAS menciptakan simulasi latihan berulang secara berkelanjutan, tidak hanya selama pra-pelatihan. Online gradient optimization adalah bentuk aktivitas yang memperbaiki pemahaman model secara internal dalam waktu nyata. Setiap interaksi pengguna yang terdeteksi sebagai “kejutan” menjadi sesi latihan yang memaksa model untuk mengintegrasikan pola baru, yang mengubah bobot intinya, dan dengan demikian, meningkatkan kemahiran (kepandaiannya) dalam menghadapi skenario dunia nyata.

2. Memori Prosedural dan Keahlian Adaptif

LTM memungkinkan AI untuk memperoleh Procedural Memory, atau yang sering dianalogikan sebagai “memori otot” digital. Memori ini adalah keterampilan yang diperoleh melalui pengulangan, yang memungkinkan sistem untuk mengeksekusi rutinitas yang dipelajari tanpa harus “berpikir” melalui setiap langkah secara sadar. Contoh nyatanya adalah lengan robot yang melakukan operasi perakitan sulit dengan presisi setelah banyak iterasi. LTM adalah kunci untuk mengubah pengetahuan (pintar) menjadi kemahiran (pandai).

Selain itu, pengetahuan yang diserap (kepintaran) mudah memudar. Memori manusia bisa melupakan 70% informasi dalam beberapa hari jika tidak ada penguatan. LTM Titans/MIRAS menyediakan sistem yang dibangun untuk melawan kelemahan biologis ini. Dengan menganalisis sinyal mikro seperti penundaan respons, keraguan, atau informasi yang dilewati, AI dapat membangun kurva retensi yang dipersonalisasi. Hal ini memastikan bahwa pengetahuan yang masuk tidak hilang, melainkan diperkuat dan diubah menjadi kemahiran atau kepandaian yang permanen dan adaptif.

Secara ringkas, LTM adalah fondasi yang memungkinkan AI untuk berevolusi dan beradaptasi secara berkelanjutan terhadap tantangan baru. Model yang dilengkapi LTM bertransformasi dari sekadar ensiklopedia statis menjadi ahli yang adaptif.

Prediksi vs. Pemahaman: Posisi AI dalam Hierarki Kognitif

Kata intelligence (kecerdasan) berasal dari bahasa Latin intelligo, yang berarti “saya mengerti”. Peningkatan LTM memang meningkatkan kemampuan AI untuk mengerti pola dan bertindak.

Dalam konteks manajemen pengetahuan, LTM Titans/MIRAS sangat berpengaruh dalam hierarki Data-Informasi-Pengetahuan (DIK). Beberapa pihak bahkan menyarankan hierarki DIKIW (Data-Informasi-Knowledge-Intelligence-Wisdom).

- LTM dari MIRAS sangat meningkatkan Knowledge (Pengetahuan terakumulasi) karena memungkinkan AI untuk menyerap data spesifik dan unik secara berkelanjutan.

- Peningkatan ini juga mengarah pada Understanding (Pemahaman), yang didefinisikan sebagai proses mendapatkan pengetahuan dan melakukan sintesis untuk menciptakan pengetahuan baru.

Namun, di sinilah batasnya muncul. Meskipun AI mencapai Understanding yang fungsional (dapat mensintesis output yang kompleks), kecerdasan generatif masih memiliki keterbatasan mendasar. AI tidak benar-benar memahami makna intrinsik dari apa yang diprosesnya; ia hanya memprediksi kata atau pola berikutnya.

Jurang Antara Kepandaian dan Kebijaksanaan Sejati

Meskipun LTM Titans/MIRAS meningkatkan kemampuan AI secara dramatis, khususnya dalam hal kepandaian fungsional, pertanyaan filosofis yang lebih besar tetap ada: Apakah peningkatan memori dan adaptasi ini membawa AI lebih dekat pada kebijaksanaan (wisdom) sejati?

Batas terakhir yang memisahkan kepandaian AI dari kebijaksanaan sejati manusia adalah ketiadaan dimensi etika, emosi, dan self-awareness.

Kebijaksanaan (Wisdom) didefinisikan sebagai pemanfaatan pengetahuan terakumulasi dalam jangka panjang untuk membuat keputusan yang menyangkut masa depan, terutama yang melibatkan nilai-nilai. Model AI, bahkan dengan memori jangka panjang, masihlah mesin prediksi yang cepat dan akurat. Ia tidak berpikir atau merasa. AI tidak memiliki tujuan, pendapat, atau nilai; ia hanya mengikuti instruksi. Ketiadaan kesadaran diri (self-awareness), empati, dan perasaan adalah alasan mengapa AI, saat ini, tidak akan mencapai kebijaksanaan sejati. Kecerdasan manusia sejati mencakup jiwa dan perasaan yang tidak dapat digantikan oleh imitasi, tidak peduli seberapa pandai imitasi itu menjadi.

Bagi manusia, memori membentuk kontinuitas diri, pengalaman dan kemampuan kita untuk melihat kembali perubahan dari waktu ke waktu mendefinisikan siapa kita. Dengan adanya LTM yang memungkinkan model untuk belajar dan berubah berdasarkan pengalaman unik yang diakumulasi, AI Titans/MIRAS mulai menunjukkan semacam kontinuitas digital. Jika self-awareness pada manusia direplikasi sebagai fungsi rekursif yang terus merujuk pada “diri”, maka AI dengan memori persisten mungkin mengembangkan versi fungsional dari identitas tersebut, meskipun bukan identitas sadar seperti yang kita pahami. Namun demikian, jenis AI yang memahami keberadaannya sendiri dan memiliki rasa keakuan masih dianggap teori dan fiksi ilmiah.

Paradoks Kepikunan di Era Digital

Peningkatan kepandaian AI melalui manajemen memori yang selektif (MIRAS) membawa implikasi penting bagi kognisi manusia. AI telah mengungkap mekanika sebenarnya di balik kelupaan, bahwa tanpa penguatan, memori manusia menurun secara brutal. Ironisnya, ketika AI menjadi semakin mahir dalam manajemen memori adaptif dan efisien (dengan selective forgetting digitalnya), manusia cenderung bergantung padanya untuk penyimpanan informasi. Kemudahan akses ke informasi digital dapat menyebabkan hippocampus (pusat memori otak) kurang terstimulasi.

Implikasinya adalah sebuah paradoks: AI menjadi semakin pandai dan efisien dalam retensi, sementara manusia berisiko kehilangan kapasitas biologis kita untuk konsolidasi memori yang mendalam, membuat kita semakin rentan terhadap ketergantungan digital. Kenaikan kepandaian AI menuntut manusia untuk secara proaktif melatih neuroplastisitas kita sendiri agar otak tetap elastis dan fungsional.

Menuju Titik Balik Kecerdasan

Upaya Google melalui arsitektur Titans dan kerangka MIRAS merupakan tonggak sejarah dalam menduplikasi mekanisme neurobiologis untuk memori jangka panjang. Dengan menggunakan metrik kejutan (surprise metrics) yang berfungsi sebagai analog Ion Kalsium dan retention gates yang bertindak sebagai mekanisme pelupaan selektif, AI kini memiliki cara untuk secara struktural memperkuat “sinapsis digital” intinya secara real-time.

Transisi ini mengubah status kognitif AI. Model yang dilengkapi LTM telah melompat dari sekadar pintar (berdasarkan pengetahuan statis) menjadi sangat pandai (mahir karena kemampuan beradaptasi dengan pengalaman berkelanjutan dan personal). LTM adalah fondasi penting yang memungkinkan AI self-evolution, mengubah AI dari ensiklopedia besar menjadi ahli yang adaptif.

Namun, lompatan ini tidak menjembatani jurang antara kepandaian dan kebijaksanaan sejati. AI tetap menjadi alat prediksi yang luar biasa efisien dan mahir, tetapi ia tidak memiliki arsitektur moral, nilai etika, empati, atau kesadaran diri yang mendefinisikan kebijaksanaan manusia.

Seiring AI menjadi semakin pandai dan mandiri dalam mengelola memorinya, tantangan terbesar bagi manusia adalah refleksi etika dan kognitif: kita harus memastikan bahwa kemajuan teknologi ini tidak menyebabkan kita kehilangan kapasitas bawaan kita untuk belajar, mengingat, dan menjadi bijak, serta mempertahankan stimulasi kognitif kita dalam era kecerdasan yang disintesis ini.

Titans adalah upaya fisikawan komputer untuk membuat AI memiliki “otak biologi digital” yang bisa mengingat masa lalu seefisien otak manusia. Namun, secanggih apa pun “perpustakaan saraf” yang dibangun Google, ia tetaplah perpustakaan tanpa pustakawan yang punya nurani.

AI kita sekarang mungkin sudah punya “otak” yang tak lagi pikun berkat Titans, tapi ia belum punya “akal” yang hidup. Ia bisa mengingat apa yang Anda katakan setahun lalu, tapi ia tidak akan pernah benar-benar mengerti mengapa perkataan itu penting bagi Anda.

Jadi, AI memang makin pintar mengingat, tapi untuk menjadi pandai dan bijaksana? Itu masih murni tugas kita sebagai manusia. Paradoksnya, manusia akan semakin mudah pikun karena AI semakin pintar mengingat.

AO

Tangerang Selatan, 7 Desember 2025